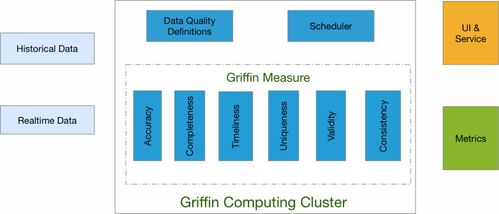

盘点大数据处理利器 从批处理到实时计算的工具全景

在大数据时代,高效、可靠的数据处理工具是挖掘数据价值、驱动业务决策的核心引擎。根据处理模式和技术栈的不同,这些工具可大致分为批处理、流处理、查询分析以及综合框架等几大类别。以下将为您系统盘点当前主流的大数据处理工具。

一、 批处理工具

批处理主要针对海量的历史静态数据进行离线计算,特点是吞吐量大、延迟高。

- Apache Hadoop:大数据领域的基石。其核心组件包括分布式文件系统HDFS(用于存储)和计算框架MapReduce(用于处理)。它适合处理超大规模数据集,但编程模型相对复杂,迭代计算效率较低。

- Apache Spark:相比Hadoop MapReduce,Spark凭借其内存计算和DAG执行引擎,在批处理性能上实现了飞跃。它提供了丰富的API(Scala, Java, Python, R),并集成了SQL、流处理、机器学习等模块,成为当前最流行的批处理框架之一。

二、 流处理(实时计算)工具

流处理专注于对无界数据流进行实时或近实时的连续计算,特点是低延迟。

- Apache Flink:真正意义上的流处理优先框架,将批处理视为流的一种特例。它提供了精确一次(exactly-once)的状态一致性保证、高吞吐和毫秒级延迟,在复杂事件处理和状态计算方面表现卓越。

- Apache Storm:早期流行的流处理系统,延迟极低,但通常只提供至少一次(at-least-once)的语义保证。

- Apache Kafka Streams:一个轻量级的客户端库,用于构建实时应用程序和微服务,直接处理存储在Kafka主题中的数据。它无需单独的处理集群,部署简单。

- Spark Streaming:作为Spark的组件,它采用微批次(Micro-Batch)模型,将流数据切成小批量进行处理,易于与Spark生态集成,但在极低延迟场景下不如纯流式框架。

三、 交互式查询与分析工具

这类工具旨在让用户能够以类似操作数据库的方式,快速查询和分析大数据。

- Apache Hive:构建在Hadoop之上的数据仓库工具,可将SQL查询转换为MapReduce或Tez/Spark任务执行,适合离线分析。

- Presto / Trino:高性能的分布式SQL查询引擎,专为交互式分析设计。它支持多种数据源(HDFS, S3, Kafka, MySQL等),可以秒级查询PB级数据,但不存储数据。

- Apache Impala:为Hadoop和HDFS设计的MPP(大规模并行处理)SQL查询引擎,提供低延迟、高并发的交互式查询能力。

- ClickHouse:一个开源的列式数据库管理系统,以其卓越的在线分析处理(OLAP)性能和极快的查询速度而闻名,特别适合实时报表和分析。

四、 综合数据处理框架与云服务

- Apache Beam:一个统一的编程模型,旨在定义批处理和流处理的数据处理流水线。其核心价值在于“一次编写,多处运行”,支持在Spark、Flink、Google Dataflow等多种底层引擎上执行。

- 云厂商全托管服务:

- Amazon EMR:集成了Hadoop、Spark、Flink、Hive等开源框架的托管集群服务。

- Google Cloud Dataflow:基于Apache Beam模型的全托管流批数据处理服务。

- Microsoft Azure HDInsight:提供Spark, Hadoop, Kafka等服务的云托管版本。

- 阿里云实时计算Flink版:基于Apache Flink的全托管实时计算平台。

五、 消息队列与数据摄取工具

数据处理的起点往往是高效的数据采集与传输。

- Apache Kafka:分布式流数据平台,兼具高吞吐量的消息队列、数据存储和流处理能力,是大数据生态中数据管道的事实标准。

- Apache Flume / Apache Sqoop:用于从各种数据源(如日志文件、关系数据库)高效地收集、聚合和移动大量数据到HDFS等集中存储的系统。

与选型建议

选择大数据处理工具时,需综合考虑业务场景(离线报表还是实时监控)、数据特性(规模、速度、结构)、团队技术栈、运维成本及与现有系统的集成度。

- 历史数据深度分析:可首选 Spark 或 Hive。

- 复杂事件实时处理与状态计算:Apache Flink 是强大选择。

- 亚秒级交互式即席查询:Presto/Trino 或 ClickHouse 表现优异。

- 构建统一的数据处理逻辑:可探索 Apache Beam。

- 希望减少基础设施运维:直接采用各大云平台的全托管服务是高效之选。

大数据处理工具生态日新月异,但核心目标始终如一:以更高效、更便捷、更经济的方式,将原始数据转化为洞察与价值。

如若转载,请注明出处:http://www.shuiwuchouhua123.com/product/60.html

更新时间:2026-06-03 03:02:08